Flyte

Flyte 是一个开源的调度器,便于构建生产级的数据和机器学习管道。 它旨在可扩展性和可重现性,利用Kubernetes作为其基础平台。

本笔记本的目的是演示如何将 FlyteCallback 集成到您的Flyte任务中,使您能够有效地监控和跟踪您的LangChain实验。

安装与设置

- 通过运行命令

pip install flytekit安装Flytekit库。 - 通过运行命令

pip install flytekitplugins-envd安装Flytekit-Envd插件。 - 通过运行命令

pip install langchain安装LangChain。 - 在您的系统上安装 Docker。

Flyte 任务

Flyte 任务 是 Flyte 的基础构建块。 要执行 LangChain 实验,您需要编写 Flyte 任务,以定义涉及的具体步骤和操作。

注意: 入门指南 提供了详细的逐步说明,指导您在本地安装 Flyte 并运行您的初始 Flyte 管道。

首先,导入必要的依赖项,以支持您的 LangChain 实验。

import os

from flytekit import ImageSpec, task

from langchain.agents import AgentType, initialize_agent, load_tools

from langchain.callbacks import FlyteCallbackHandler

from langchain.chains import LLMChain

from langchain_openai import ChatOpenAI

from langchain_core.prompts import PromptTemplate

from langchain_core.messages import HumanMessage

设置必要的环境变量以使用 OpenAI API 和 Serp API:

# Set OpenAI API key

os.environ["OPENAI_API_KEY"] = "<your_openai_api_key>"

# Set Serp API key

os.environ["SERPAPI_API_KEY"] = "<your_serp_api_key>"

将 <your_openai_api_key> 和 <your_serp_api_key> 替换为从 OpenAI 和 Serp API 获得的相应 API 密钥。

为了保证管道的可重现性,Flyte 任务是容器化的。 每个 Flyte 任务必须与一个镜像关联,该镜像可以在整个 Flyte 工作流 中共享,或为每个任务单独提供。

为了简化为每个 Flyte 任务提供所需依赖项的过程,您可以初始化一个 ImageSpec 对象。

这种方法会自动触发 Docker 构建,减轻用户手动创建 Docker 镜像的需求。

custom_image = ImageSpec(

name="langchain-flyte",

packages=[

"langchain",

"openai",

"spacy",

"https://github.com/explosion/spacy-models/releases/download/en_core_web_sm-3.5.0/en_core_web_sm-3.5.0.tar.gz",

"textstat",

"google-search-results",

],

registry="<your-registry>",

)

您可以灵活地将 Docker 镜像推送到您选择的注册表。 Docker Hub 或 GitHub Container Registry (GHCR) 是一个方便的起始选项。

一旦选择了注册表,您可以继续创建记录 LangChain 指标到 Flyte Deck 的 Flyte 任务。

以下示例演示与 OpenAI LLM、链和带工具的代理相关的任务:

大型语言模型

@task(disable_deck=False, container_image=custom_image)

def langchain_llm() -> str:

llm = ChatOpenAI(

model_name="gpt-3.5-turbo",

temperature=0.2,

callbacks=[FlyteCallbackHandler()],

)

return llm.invoke([HumanMessage(content="Tell me a joke")]).content

链

@task(disable_deck=False, container_image=custom_image)

def langchain_chain() -> list[dict[str, str]]:

template = """You are a playwright. Given the title of play, it is your job to write a synopsis for that title.

Title: {title}

Playwright: This is a synopsis for the above play:"""

llm = ChatOpenAI(

model_name="gpt-3.5-turbo",

temperature=0,

callbacks=[FlyteCallbackHandler()],

)

prompt_template = PromptTemplate(input_variables=["title"], template=template)

synopsis_chain = LLMChain(

llm=llm, prompt=prompt_template, callbacks=[FlyteCallbackHandler()]

)

test_prompts = [

{

"title": "documentary about good video games that push the boundary of game design"

},

]

return synopsis_chain.apply(test_prompts)

代理

@task(disable_deck=False, container_image=custom_image)

def langchain_agent() -> str:

llm = OpenAI(

model_name="gpt-3.5-turbo",

temperature=0,

callbacks=[FlyteCallbackHandler()],

)

tools = load_tools(

["serpapi", "llm-math"], llm=llm, callbacks=[FlyteCallbackHandler()]

)

agent = initialize_agent(

tools,

llm,

agent=AgentType.ZERO_SHOT_REACT_DESCRIPTION,

callbacks=[FlyteCallbackHandler()],

verbose=True,

)

return agent.run(

"Who is Leonardo DiCaprio's girlfriend? Could you calculate her current age and raise it to the power of 0.43?"

)

这些任务作为在Flyte中运行您的LangChain实验的起点。

在Kubernetes上执行Flyte任务

要在配置的Flyte后端上执行Flyte任务,请使用以下命令:

pyflyte run --image <your-image> langchain_flyte.py langchain_llm

此命令将启动在Flyte后端上执行langchain_llm任务。您可以以类似的方式触发其余两个任务。

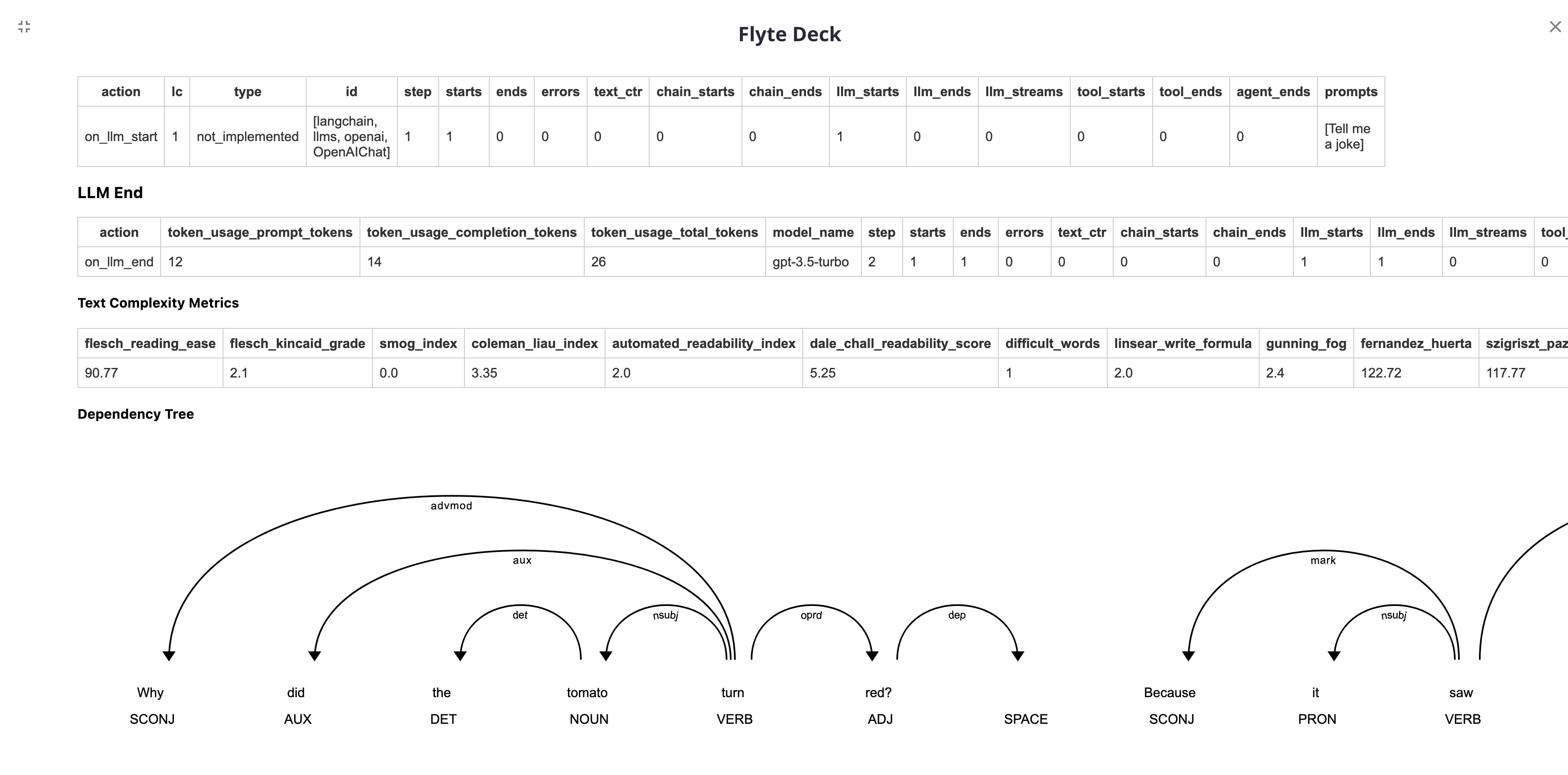

指标将在Flyte UI上显示如下: